บทความจาก techmx

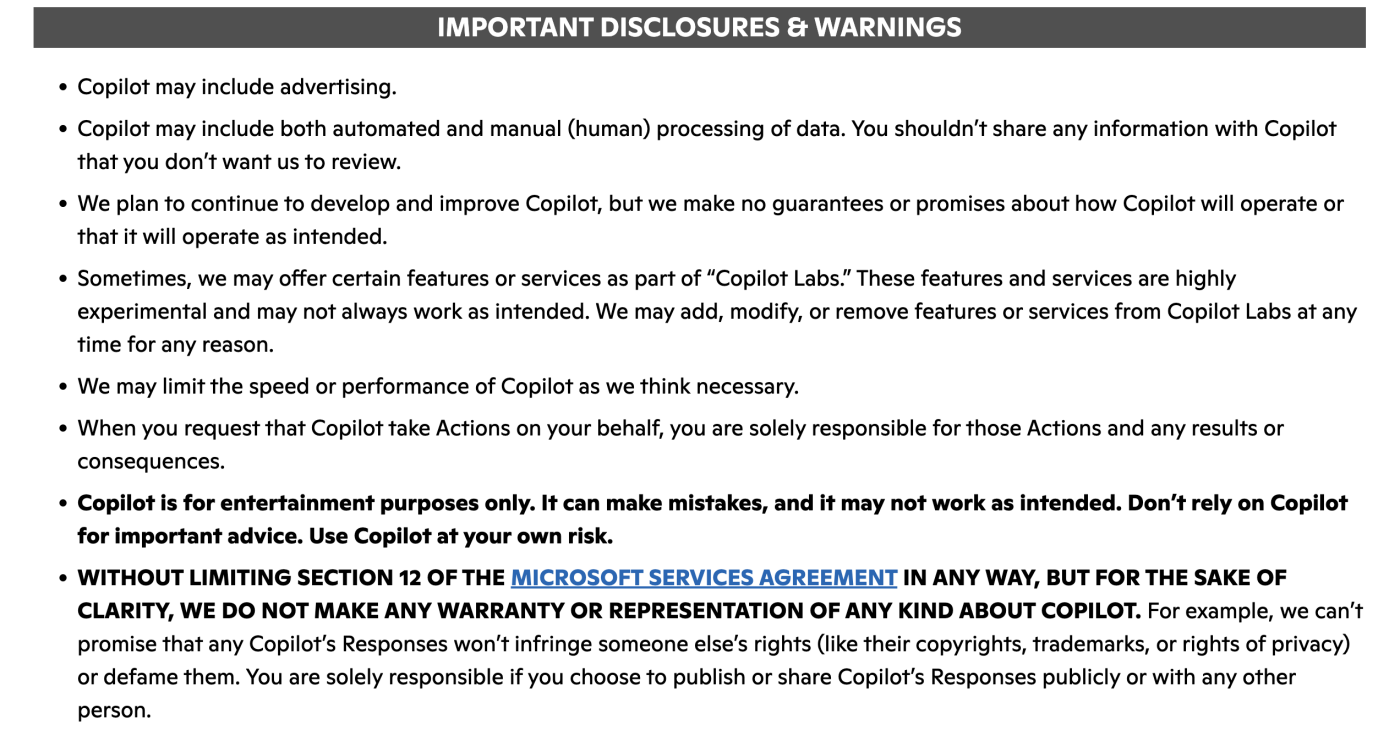

ในขณะที่ Microsoft พยายามผลักดัน Copilot ให้เป็นเครื่องมือ AI อัจฉริยะเพื่อเพิ่มประสิทธิภาพการทำงานและขับเคลื่อนธุรกิจ แต่ล่าสุดกลับมีการค้นพบข้อความในเงื่อนไขการใช้บริการ (Terms of Use) ที่ระบุว่า “Copilot มีไว้เพื่อจุดประสงค์ด้านความบันเทิงเท่านั้น” (Copilot is for entertainment purposes only) ซึ่งข้อความนี้เริ่มถูกแชร์และวิพากษ์วิจารณ์อย่างกว้างขวางบนโลกโซเชียล

การอัปเดตเงื่อนไขนี้เกิดขึ้นอย่างเงียบๆ ตั้งแต่ช่วงปลายปีที่ผ่านมา โดยมีรายละเอียดเพิ่มเติมว่า “AI อาจทำข้อผิดพลาดและอาจไม่ทำงานตามที่คาดหวังไว้ อย่าเชื่อถือ Copilot สำหรับคำแนะนำที่สำคัญ และการใช้งานถือเป็นความเสี่ยงของผู้ใช้เอง” นอกจากนี้ Microsoft ยังระบุว่าบริษัทไม่มีการรับประกันใดๆ เกี่ยวกับคำตอบของ AI รวมถึงไม่รับรองว่าคำตอบนั้นจะไม่ละเมิดสิทธิ์ของผู้อื่น เช่น ลิขสิทธิ์ เครื่องหมายการค้า หรือสิทธิ์ส่วนบุคคล

ประเด็นดังกล่าวสร้างความเคลือบแคลงใจให้กับผู้ใช้งาน โดยเฉพาะกลุ่มธุรกิจที่ Microsoft พยายามเจาะตลาดด้วยภาพลักษณ์ของความน่าเชื่อถือ ผู้ใช้งานใน Reddit บางรายตั้งข้อสังเกตว่า หากแม้แต่ Microsoft เองยังไม่กล้ายืนยันความถูกต้องของผลิตภัณฑ์ แล้วผู้บริโภคจะมอบความไว้วางใจให้ได้อย่างไร

นอกจากนี้ยังมีผู้ตั้งข้อสังเกตว่า การใช้คำว่า “เพื่อความบันเทิงเท่านั้น” เป็นกลยุทธ์ทางกฎหมายเพื่อป้องกันการถูกฟ้องร้อง (Disclaimer) ซึ่งเป็นรูปแบบเดียวกับที่ธุรกิจบริการด้านจิตวิญญาณหรือหมอดูใช้ เพื่อหลีกเลี่ยงความรับผิดชอบหากคำแนะนำส่งผลเสียต่อการตัดสินใจด้านกฎหมาย การเงิน หรือการแพทย์ โดยปัจจุบัน Microsoft เองก็กำลังเผชิญกับคดีความที่เกี่ยวข้องกับการละเมิดข้อมูลจากการลงทุนใน OpenAI อยู่เป็นทุนเดิม

การระบุเงื่อนไขในลักษณะนี้สะท้อนให้เห็นถึงความระมัดระวังขั้นสูงสุดของยักษ์ใหญ่เทคโนโลยีต่อความไม่แน่นอนของ Generative AI ที่ยังคงมีปัญหาเรื่องการ “หลอน” (Hallucination) หรือการสร้างข้อมูลที่เป็นเท็จ ซึ่งดูเหมือนว่าในทางกฎหมายแล้ว Microsoft ยังคงจัดให้ AI รุ่นนี้เป็นเพียงเครื่องมือสำหรับสร้างความบันเทิงมากกว่าจะเป็นที่ปรึกษาทางธุรกิจที่พึ่งพาได้ 100% อย่างไรก็ตามมีการเปิดเผยว่าทาง Microsoft มีแผนจะแก้ไขข้อความปฏิเสธความรับผิดชอบในเร็วๆ นี้

ที่มา: pcmag