AI กำลังเปลี่ยนแปลงโลกธุรกิจอย่างมหาศาล แต่ในขณะเดียวกันก็สร้างความเสี่ยงใหม่ที่องค์กรไม่สามารถมองข้ามได้ “AI Security Paradox” คือการเตือนว่า ความมั่นใจที่ไม่สอดคล้องกับความจริงอาจเป็นช่องโหว่ร้ายแรงที่สุด การสร้างระบบที่ปลอดภัยและการลงทุนในทักษะของพนักงานคือเส้นทางเดียวที่จะทำให้องค์กรอยู่รอดในยุคที่ AI ไม่ได้เป็นเพียงเครื่องมือสร้างโอกาส แต่ยังเป็นอาวุธของผู้โจมตี

ในโลกธุรกิจที่กำลังเร่งนำเทคโนโลยีปัญญาประดิษฐ์ (AI) เข้ามาใช้เพื่อเพิ่มประสิทธิภาพ ความปลอดภัยทางไซเบอร์กลับกลายเป็นประเด็นที่น่ากังวลมากขึ้นเรื่อย ๆ งานวิจัยล่าสุดจาก Accenture ชี้ให้เห็นถึง “AI Security Paradox” หรือความย้อนแย้งที่เกิดขึ้นเมื่อพนักงานเชื่อมั่นว่าตนเองสามารถรับมือกับภัยคุกคามไซเบอร์ได้ แต่ในความเป็นจริงพวกเขากลับขาดการฝึกอบรมและทักษะที่จำเป็นในการเผชิญหน้ากับภัยคุกคามที่ซับซ้อนขึ้นทุกวัน

...รายงาน State of Cybersecurity Resilience 2025 ระบุว่า 90% ของบริษัททั่วโลกยังไม่มีความสามารถเพียงพอในการป้องกันภัยคุกคามที่ขับเคลื่อนด้วย AI ขณะเดียวกันมีเพียง 36% ของผู้นำองค์กรที่ยอมรับว่าการพัฒนา AI กำลังแซงหน้ามาตรการความปลอดภัยที่มีอยู่

นี่คือช่องว่างที่อันตราย เพราะในขณะที่องค์กรเร่งนำ AI มาใช้เพื่อสร้างความได้เปรียบทางธุรกิจ พวกเขากลับเปิดประตูให้กับการโจมตีรูปแบบใหม่ที่ใช้ AI เป็นเครื่องมือ

หนึ่งในประเด็นที่น่าตกใจคือพนักงานจำนวนมาก โดยเฉพาะคนรุ่นใหม่ มีความมั่นใจสูงเกินจริง ตัวเลขจากรายงานเผยว่า หนึ่งในสี่ของพนักงานชาวอังกฤษอายุต่ำกว่า 35 ปีจะตอบสนองต่อข้อความที่น่าสงสัย หากเชื่อว่ามาจากหัวหน้าหรือเพื่อนร่วมงาน และ 15% ยอมรับว่าจะส่งข้อมูลบริษัทหรืออนุมัติการชำระเงินผ่านแอปแชทโดยไม่ตรวจสอบตัวตนผู้ส่ง หากข้อความนั้นดูเหมือนมาจากผู้จัดการ

แม้ว่า 81% ของพนักงานเชื่อว่าตนสามารถแยกแยะการโจมตีแบบฟิชชิ่งได้ แต่ความจริงกลับตรงกันข้าม ความมั่นใจที่ไม่สอดคล้องกับทักษะจริงนี้คือสิ่งที่ Kamran Ikram หัวหน้าฝ่ายความปลอดภัยของ Accenture ในสหราชอาณาจักรและไอร์แลนด์ เรียกว่า “อันตรายจากการหลงเชื่อในความมั่นใจ” เพราะอาชญากรไซเบอร์ในยุค AI ไม่ได้โจมตีระบบเท่านั้น แต่พุ่งเป้าไปที่ “ความไว้วางใจ” ของมนุษย์

ภัยคุกคามที่น่ากลัวที่สุดในปัจจุบันคือการโจมตีแบบ Social Engineering ที่ใช้ AI สร้างข้อความหรือเสียงที่สมจริงอย่างน่าทึ่ง

อาชญากรสามารถดึงข้อมูลจากโซเชียลมีเดียมาสร้างข้อความที่ดูเหมือนมาจากเพื่อนหรือหัวหน้า ทำให้พนักงานต้องตัดสินใจอย่างรวดเร็วโดยไม่ทันตรวจสอบ ความสามารถของ AI ในการสร้าง Deepfake และข้อความที่น่าเชื่อถือกำลังทำให้เส้นแบ่งระหว่าง “จริง” และ “ปลอม” เลือนรางลงอย่างน่ากังวล

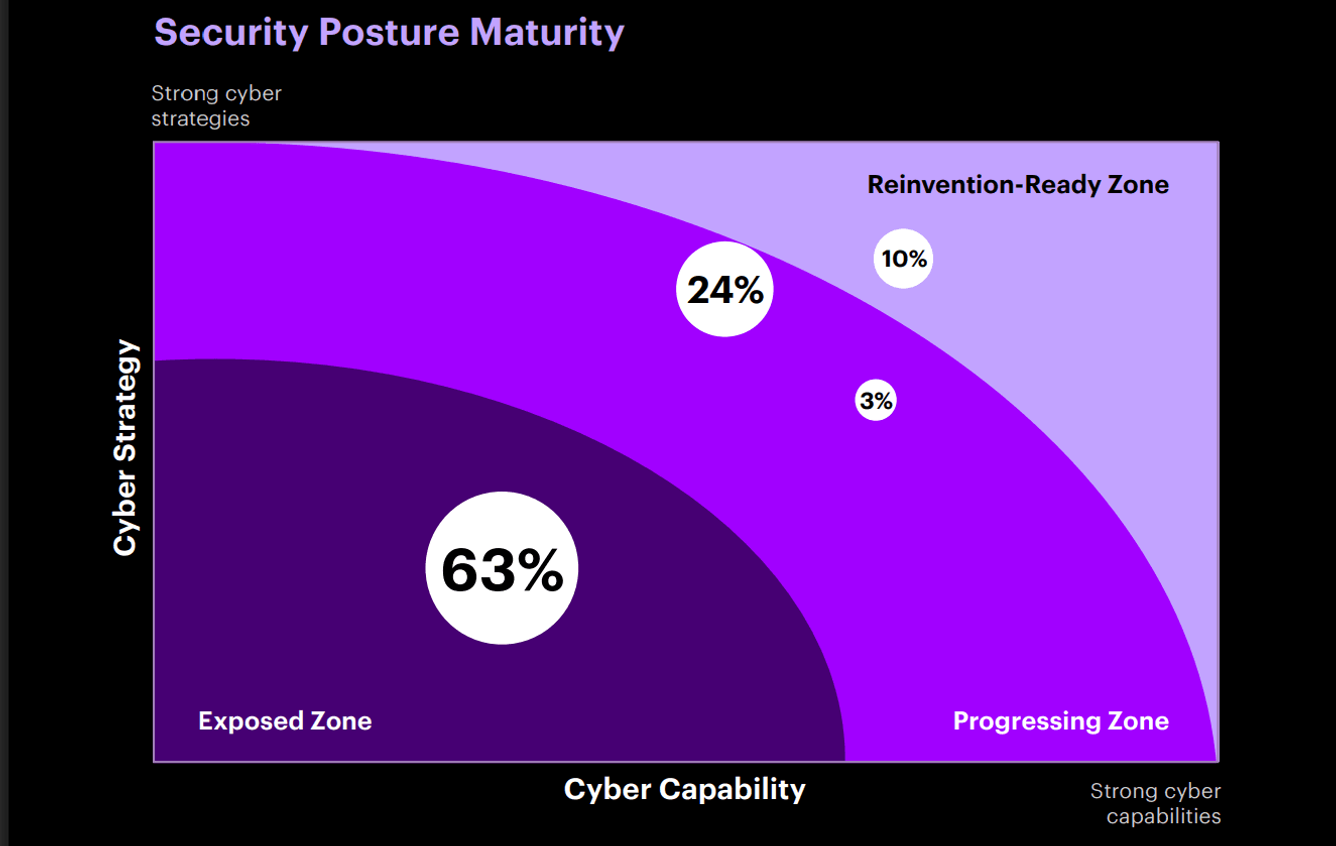

รายงานยังเผยว่า มากกว่าหนึ่งในสามของพนักงานในสหราชอาณาจักรไม่เคยได้รับการฝึกอบรมด้านความปลอดภัยไซเบอร์เลย และมีเพียง 20% ที่ได้รับการฝึกให้สามารถตรวจจับ Deepfake หรืออีเมลฟิชชิ่งที่สร้างโดย AI นี่คือจุดอ่อนที่ทำให้บริษัทจำนวนมากตกอยู่ใน “Exposed Zone” หรือเขตเสี่ยงสูงสุดตามการจัดหมวดหมู่ของ Accenture โดยมีถึง 63% ขององค์กรที่อยู่ในกลุ่มนี้ ขณะที่มีเพียง 10% เท่านั้นที่อยู่ใน “Reinvention-ready Zone” ซึ่งมีโอกาสถูกโจมตีน้อยกว่าถึง 69%

เส้นทางสู่การป้องกันที่ยั่งยืน

Accenture เสนอแนวทาง 4 ประการเพื่อให้องค์กรก้าวสู่การเป็น “Reinvention-ready” ได้แก่

- สร้างกรอบการกำกับดูแลด้านความปลอดภัยที่ครอบคลุมทั้งองค์กร โดยคำนึงถึงความเป็นจริงใหม่ในโลกที่ถูก AI รบกวน

- ออกแบบระบบดิจิทัลที่ “Secure by Default” ฝังความปลอดภัยไว้ในทุกชั้นของการพัฒนาและใช้งาน AI

- รักษาความยืดหยุ่นของระบบ AI ด้วยการจัดการภัยคุกคามเชิงรุกและเฉพาะทาง

- ใช้ Generative AI เพื่อเสริมกำลังบุคลากรด้านความปลอดภัย ลดช่องว่างทักษะ และเพิ่มความเร็วในการตรวจจับภัยคุกคาม

Kamran Ikram เน้นว่าองค์กรไม่สามารถพึ่งพาการเตรียมการที่ไม่ทั่วถึงได้ เพราะผู้โจมตีกำลังพัฒนาเทคนิคใหม่ทุกวัน การสร้างวัฒนธรรมการเรียนรู้และการฝึกอบรมต่อเนื่องคือหัวใจสำคัญในการรับมือกับภัยคุกคามที่เปลี่ยนแปลงอย่างรวดเร็ว

Key Takeaways

- ความมั่นใจของพนักงานสูงเกินจริง ขณะที่การฝึกอบรมด้านความปลอดภัยยังขาดแคลน

- 90% ของบริษัททั่วโลกยังไม่พร้อมรับมือภัยคุกคามที่ขับเคลื่อนด้วย AI

- Social Engineering ที่ใช้ AI เป็นอาวุธกำลังทำให้การตรวจจับภัยคุกคามยากขึ้น

- การฝึกอบรมต่อเนื่องและการสร้างระบบ “Secure by Default” คือหัวใจในการป้องกัน

- องค์กรที่อยู่ใน “Reinvention-ready Zone” มีโอกาสถูกโจมตีน้อยกว่าถึง 69%

…..

เรียบเรียงโดย AiNextopia

Sources: AI Security Paradox: Are Firms Overconfident On AI Threats?.